一点通收录怎么做比较快:拆解秒收录的底层逻辑与实操盘点(一点通收录是什么意思)

你刚熬夜写完一篇自认为惊天地泣鬼神的文章,点击发布,然后满怀期待地去搜索引擎里输入这串网址,结果网页上冷冰冰地显示出找不到和您查询的相符网页。一天过去,一周过去,依然是光头。为什么?因为你把爬虫当成了随叫随到的环卫工人,觉得只要你扔了垃圾,它就必须得来收。

搜索引擎的抓取爬虫本质上是一个极端势利的投资银行家。它每天手里捏着固定的预算,也就是行业里常说的抓取预算,要在浩如烟海的『互联网』里寻找最有价值的资产。如果你的网站响应慢、结构乱、内容水,它会毫不犹豫地掉头就走,连个标点符号都不会给你留下。想要让收录速度飞起来,就必须彻底打破这种被动等待的局面,把最高质量的数据,用最顺畅的管道,直接喂到它的嘴里。

别信市面上那些玄之又玄的魔法,收录的核心逻辑永远是:发现成本低、抓取无障碍、内容高价值。我们直接把这层窗户纸捅破,看看真正能让页面秒收录的硬核操作到底是什么。

砸通底层管道

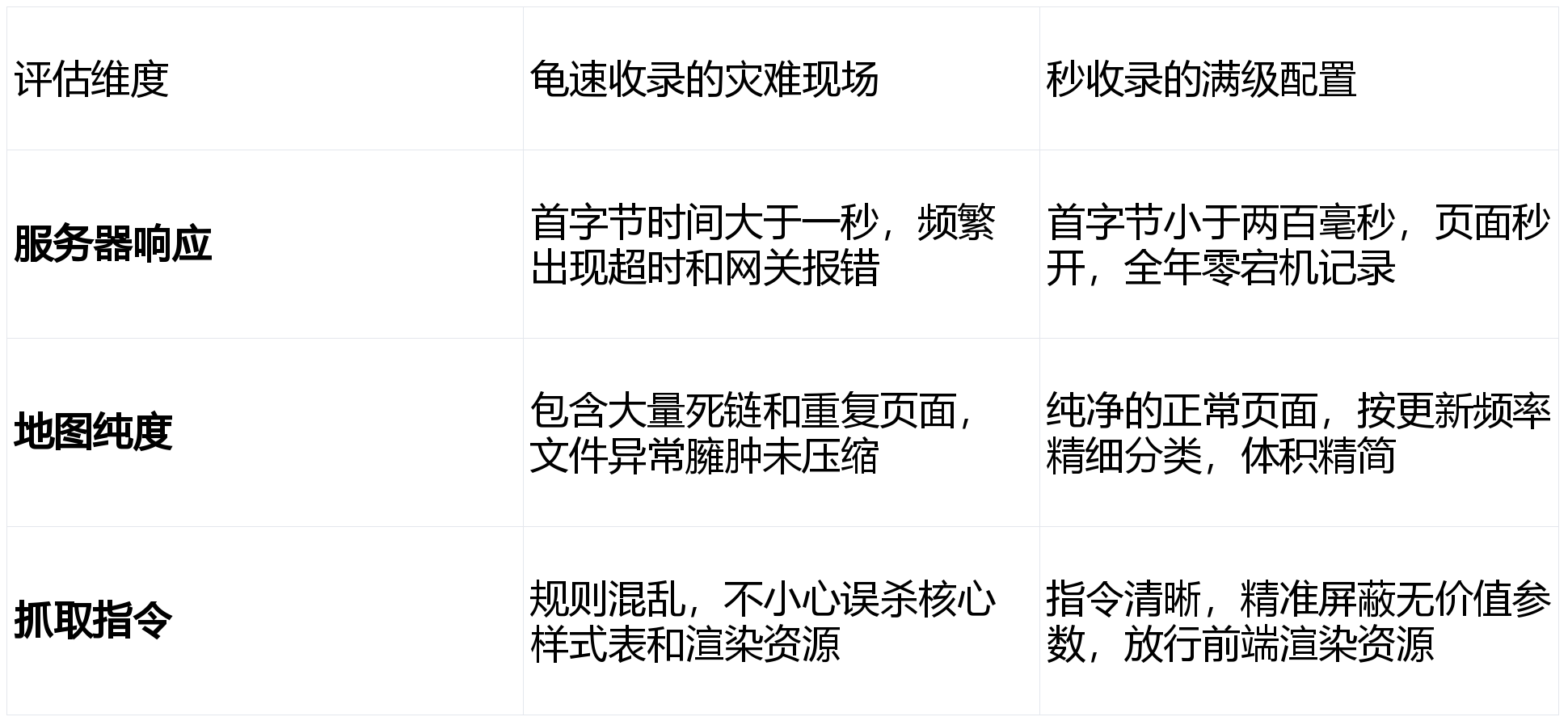

脱离了『服务器』基础去谈优化,纯粹是在沙滩上建高楼。爬虫的工作时间是以毫秒计算的。如果你的『服务器』响应时间经常超过五百毫秒,或者『域名解析』总是卡顿,爬虫在你的网站上走一步卡三步,它下一次分配给你的抓取配额就会断崖式下跌。它不可能在一个破破烂烂的土路上开跑车。

必须把『服务器』的响应速度优化到极致。配置靠谱的内容分发网络,开启静态资源缓存,精简数据库查询逻辑,让网页的首字节到达时间压缩到两百毫秒以内。当爬虫发现你的网站像高速公路一样畅通无阻时,它会极其乐意频繁光顾。很多新站长图便宜买劣质的共享虚拟主机,导致爬虫三天两头遇到请求超时报错,这种底盘不稳的网站,发再多优质内容也是白搭。

除了硬速度,抓取协议和站点地图就是爬虫的红绿灯和高精度导航仪。千万别把地图文件当成一个什么都装的垃圾桶🗑️,什么乱七八糟的死链、重定向页面、毫无意义的标签页都往里塞。一个满级的站点地图应该只包含状态码为正常、且对搜索用户真正有价值的核心页面。如果你喂给爬虫的地图里有一半是死胡同,它很快就会彻底无视你的导航,甚至降低对你整个域名的信任度。

主动喂给引擎

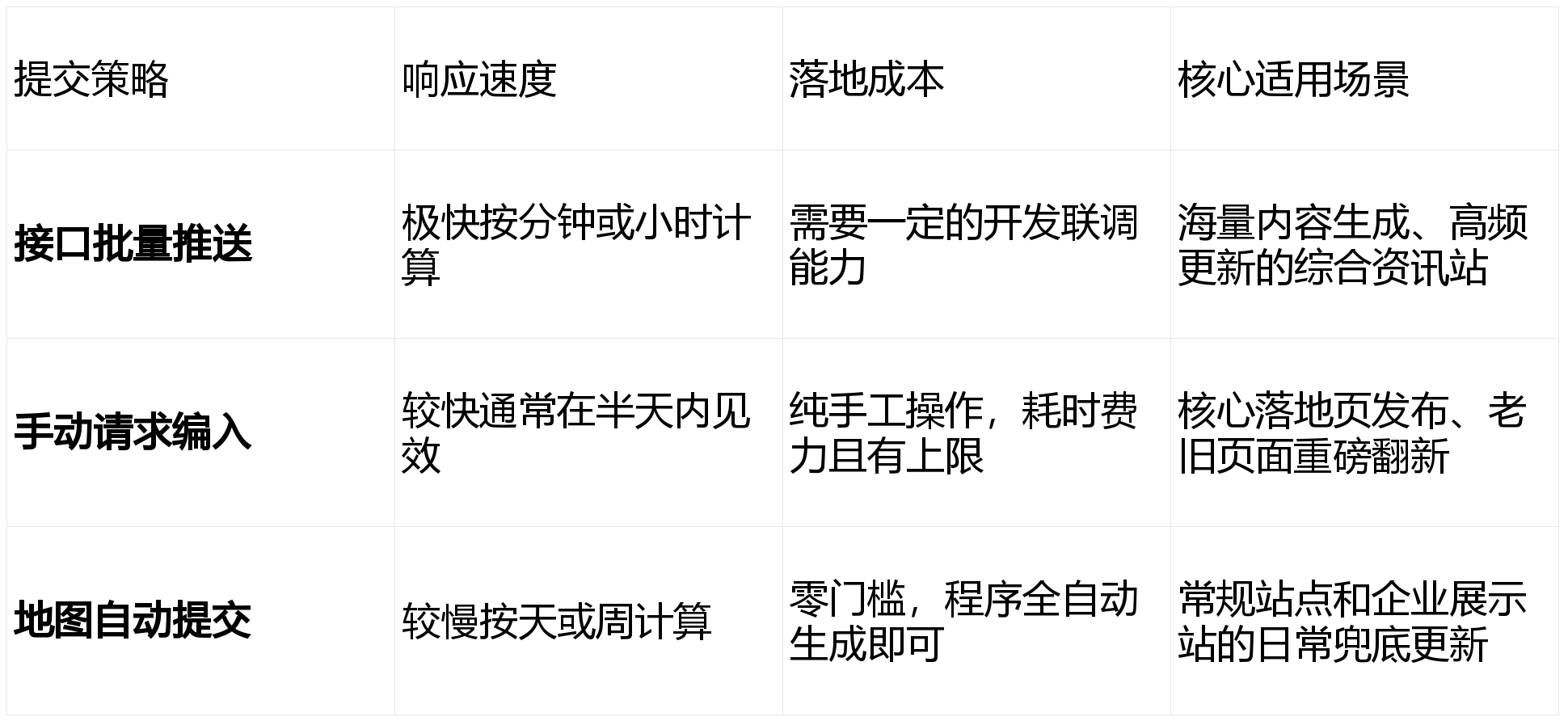

守株待兔是做网站最愚蠢的策略。有了新内容,必须主动出击。官方提供的各类站长工具和接口,就是你用来直接敲门的神器。很多人以为官方的索引接口只是用来提交短暂生效的招聘信息或者实时直播页面的,大错特错。

经过无数实战验证,将普通的文章内容通过官方索引接口进行实时推流,依然有着极其恐怖的收录效率。在你的网站后台配置好自动触发机制,只要文章一点击发布,后台立刻将网址打包通过接口直连官方『服务器』。这相当于你拿到了贵宾通道的最高级门禁卡,直接跳过了漫长的等待被发现环节。官方『服务器』收到信号后,会立刻将你的网址放入待抓取队列,大大缩短了收录周期。

对于老页面的重大更新,站长工具里的网址检查并请求编入索引依然是单兵作战的神器。虽然它每天有严格的提交额度限制,但对于核心业务页面的紧急收录,这种纯手工干预的优先级绝对是最高的。配合主动推送站点地图的机制,多管齐下,让官方『服务器』在第一时间感知到你网站的心跳。

撕开前端伪装

现在的前端开发人员特别喜欢用一些极其炫酷的现代框架,做出来的单页应用视觉效果确实炸裂,交互体验极其丝滑,但这简直是收录的超级噩梦。对于普通用户来说,浏览器会乖乖下载并执行所有的前端脚本,最终呈现出华丽的页面。但是对于极其吝啬计算资源的爬虫来说,它的初始抓取通常只会看最原始的静态代码。

如果你的网页重度依赖客户端渲染,爬虫第一眼看到的只是一个空荡荡的代码壳子,里面除了一个脚本加载指令外一无所有。官方虽然早已具备了渲染复杂脚本的能力,但这绝对是一个分为两波的延迟过程。第一波先抓取基础框架,等哪天它的渲染『服务器』闲下来了,有富裕的算力了,才会启动第二波去执行你的脚本并抓取真实渲染出的文字内容。这个致命的时间差,短则几天,长则半个多月。

想要快收录,必须彻底撕开这层伪装。要么老老实实切回传统的服务端渲染模式,把最终生成好的纯静态内容直接喂给爬虫;要么采用动态渲染技术,一旦侦测到是爬虫来访,直接吐出预先渲染好的静态快照页面。千万别让爬虫去干极其耗费性能的运算苦力活,它一旦觉得累,你的收录周期就彻底失控了。

织密内部大网

孤岛页面是永远无法被收录的。爬虫的行进路线是典型的顺藤摸瓜,它必须通过已知的链接桥梁才能发现未知的全新页面。如果你发了一篇极其牛逼、深度极高的文章,但这篇文章在首页没有给足曝光入口,在列表页被迅速翻到了第十页以后,甚至没有任何其他相关的老文章给它做上下文导流,它就成了一座无人问津的死城。

扁平化且网状交织的网站架构是加速收录的绝对核心。任何一个重要的新页面,距离首页的点击次数绝对不能超过三次。合理利用全局面包屑导航,不仅能让普通用户清晰地知道自己身处何方,更能让爬虫极其清晰地理解网站的物理层级和逻辑关系。对『于海』量数据的巨型网站,千万不要做成那种深不见底的目录迷宫。

在文章内部,极其刁钻且高度精准的上下文内链,就是爬虫的高速穿梭通道。当爬虫在抓取一篇具有极高历史权重的老文章时,顺着正文里自然植入的超链接,瞬间滑向了你的新文章,这种基于高度上下文相关性的抓取,信任权重传递效率极高。别忘了在网站的全局底部挂一个直达核心分类的静态导航区域,这就好比给爬虫留了一张全站通用的高精度雷达图。

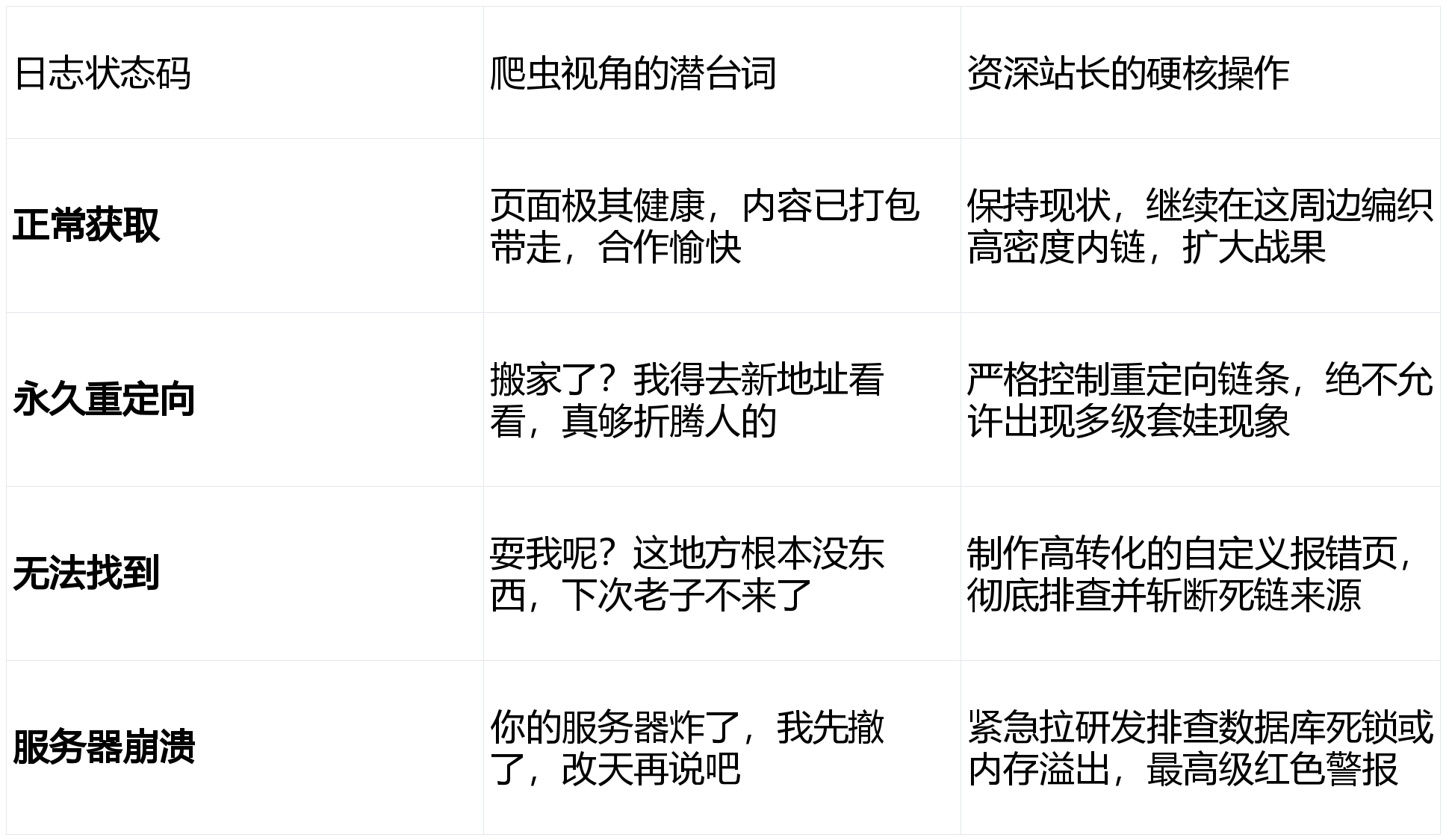

盯死错误日志

前端的访问数据都是经过美颜处理的,想要看到最残酷、最血淋淋的真相,必须扒开『服务器』的原始访问日志。日志是绝对不会撒谎的,它逐行记录了爬虫在你网站上的一举一动、每一次呼吸。很多站长天天抱怨不收录,结果去日志里深挖一查,发现爬虫每天来上万次,但绝大部分精力全耗在了抓取网站的无限下拉日历、或者是带有一大堆无效参数的商品筛选网址上。

这就是典型的抓取预算大出血,等同于慢性自杀。你必须通过深度的日志分析,找出这些让爬虫陷入死循环的蜘蛛陷阱。利用规范化标签强制合并重复的冗余页面,通过抓取协议无情地屏蔽掉那些带有无价值参数的后缀网址。不要觉得爬虫是万能的,给它看什么,它就傻乎乎地去抓什么,必须由你来主导它的行进路线。

同时必须密切监控日志里的状态码异常波动。如果爬虫频繁遭遇找不到页面的残酷报错,或者陷入一环套一环的重定向死循环,它对你网站的基础信任度就会迅速降至冰点。必须把有限的抓取预算,像保护眼睛一样严密保护起来,全部引导到你最核心、最能产生商业价值的页面上。

投放优质诱饵

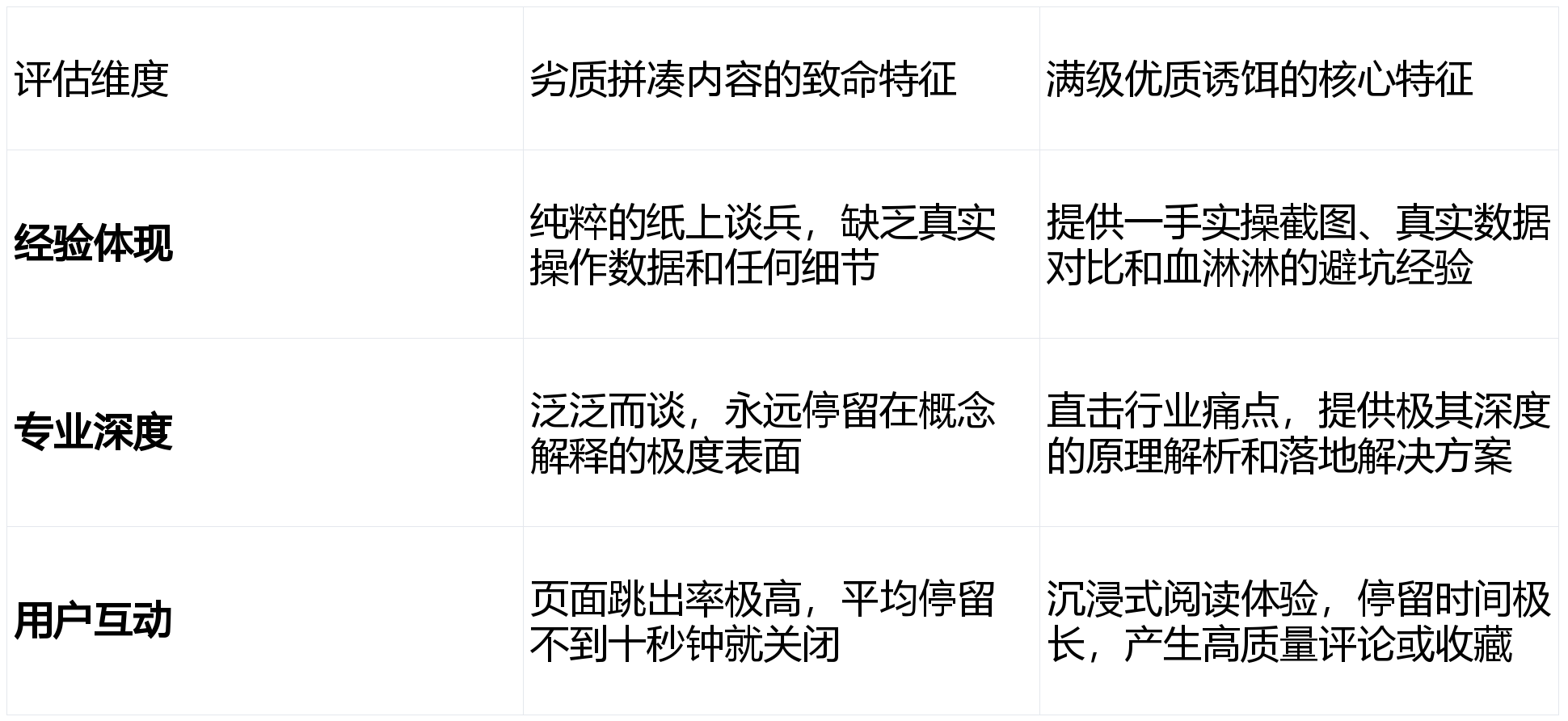

『互联网』最不缺的就是海量的信息垃圾。洗稿伪原创、机器疯狂采集、毫无逻辑的词语堆砌,这些粗制滥造的东西在智能算法眼里就是有毒的工业废料。官方的数据库存储成本是极其高昂的,它绝对不会浪费昂贵的硬盘阵列去存一堆毫无商业和阅读价值的重复内容。在经验、专业性、权威性和信任感这套极度严苛的评估标准下,敷衍了事的文字根本过不了基础质量这第一关。

内容质量本身就是最硬核、最底层的收录催化剂。当爬虫连续几次在你的网站上抓取到了具有独特行业见解、数据极其详实、能够瞬间解决搜索者痛点的稀缺内容后,它会在核心算法内部给你的域名打上高质量内容源的极品标签。一旦这个信任标签牢固建立,你的基础抓取频率会呈指数级上升。

把文章的前两百个字当成生死线来写,直接亮明核心观点,别绕任何弯子。用极其清晰的逻辑结构把页面划分得干干净净,适时穿插完全原创的数据图表或深度的行业见解。当你的页面能够产生极低的用户跳出率和极长的人均停留时间时,这种正向的真实用户互动信号最终会强力反哺抓取引擎,让你的新内容在发布瞬间就被列入超级优先抓取队列。

借势外部推力

当你的网站还是个无人问津的新站,域名本身毫无权威度可言,这时候单靠自己内部折腾,收录依然会像蜗牛一样慢。你必须学会极其聪明的借力打力。那些高权重的新闻门户、极度活跃的行业垂直论坛以及顶级的『社交媒体』平台,官方的爬虫是全天候二十四小时高密度驻扎在上面的。

一旦你的新页面网址出现在这些高频抓取的核心节点上,爬虫就会像闻到血腥味的鲨鱼一样顺着外部链接疯狂游过来。这是通过外部高权重节点强制吸引蜘蛛抓取的经典暴力战术。千万不要小看这些外部巨头平台的力量,它们的基础设施和自带的庞大抓取配额是你刚起步时根本难以企及的。

在你发布核心重磅内容后,必须迅速在各大高质量外部平台上进行多维度的分发和引流。哪怕这些外部链接带有不传递权重的限制标签,它依然具备极强的引导爬虫发现功能。利用别人搭建好的强悍基础设施,作为自己新页面加速起飞的发射台,这是打破初期收录僵局、快速建立初始信任度最简单粗暴的有效手段。

斩断灰色路子

这个行业里到处充斥着所谓泛站群、强推蜘蛛池、黑帽秒收录的灰色甚至黑科技广告。这些套路的本质是利用海量的垃圾废弃域名互相交叉链接,试图用粗暴的人海战术强行把爬虫绑架到你的网站上。听起来似乎很猛,实际操作下去全部都是致命的巨坑。

这种玩法在十多年前或许还能骗得几分短期流量,但在今天极其先进的深度机器学习算法面前,纯粹是自寻死路。异常的外部低质链接短时间内暴增、毫无逻辑的劣质蜘蛛池强行导入,会瞬间触发官方核心反作弊雷达的最高级别警报。结果往往极其惨烈:经历短暂几天的收录暴涨虚假繁荣后,域名直接被无情拉黑,永久打入算法的冷宫,万劫不复。别去试图挑战顶级算法科学家的智商,最后重伤出局的绝对是你自己。

永远不要试图在底层算法的红线边缘疯狂试探和反复横跳。把全部的精力和预算砸在优化『服务器』底层性能、梳理绝对清爽的抓取通道、以及死磕硬核原创内容上。优化是一场极度拼内功的残酷马拉松,只有底盘扎得够稳,内容引擎马力够强,你的每一次发布,才能精准踩中秒收录的极速节拍,真正享受自然流量带来的复利爆发。